Roboter-Dirigenten, die Stimmen der Toten und die Frage, wie KI unsere Klassik verändern wird. Ein Essay von Michael Schmidt.

English summary: In an increasingly AI-driven music world, human creativity remains essential. Michael Schmidt highlights that while AI can analyze and generate music, emotional depth, societal meaning, and true innovation stem from human input. Legal, ethical, and artistic questions arise, especially around copyright and authorship. Tools like Suno or Google Gemini enable broader access to music creation, but cannot replace the uniquely human aspects of musical expression and collaboration.

Welche Rolle spielt der Mensch in einer zunehmend automatisierten Musikwelt? Michael Schmidt lehrt multimediale Musikvermittlung an der Hochschule für Musik und Theater München und schreibt über das Spannungsfeld zwischen Innovation und Urheberrecht sowie den Wert menschlicher Kreativität in Zeiten leistungsfähiger KI. Eine seiner Hauptthesen: Trotz technologischer Perfektion bleibt die Rolle des Menschen zentral, da kreative Tiefe, emotionale Resonanz und gesellschaftliche Bedeutung durch KI allein nicht vollständig ersetzt werden können.

Dieser Aufsatz ist Auszug eines Essays im neu erschienenen Buch »Künstliche Intelligenz der Töne«, in dem unter anderen auch Beiträge von Fritz Lauterbach, Ali Nikrang oder Dorte Lena Eilers versammelt sind. Das Buch ist gerade in der edition text+kritik erschienen.

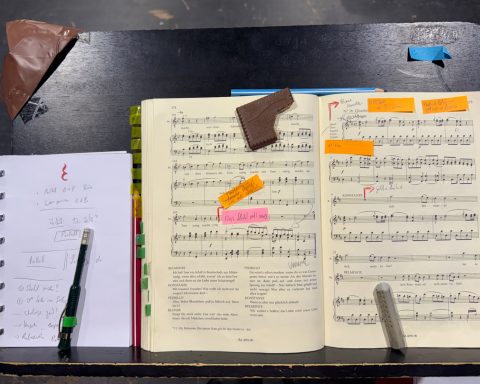

Zur Musik des Instruments

Inzwischen vermag Künstliche Intelligenz, durch sogenannte »Deep Learning«-Prozesse Muster wie typische Ton- und Harmoniefolgen, aber auch größere Struktur- und Stilmerkmale von Musiken zu erkennen sowie Varianten daraus zu bilden. Bei einem musikalischen Experiment des chinesischen Huawei-Konzerns sollte bereits 2019 eine solche selbstlernende, mit über 90 Werken von Franz Schubert trainierte KI dessen Unvollendete Symphonie vollenden. Für das Schuberts Musik zwar nachahmende, streckenweise aber mehr wie Filmmusik klingende Ergebnis wurden die von der KI vorgeschlagenen Varianten noch von einem Komponisten selektiert, modifiziert und strukturiert.

Dem mithilfe einer KI aus Audio-Fragmenten von John Lennon komplettierten und clever als letzter Song der Beatles vermarkteten Titel Now and Then gelang es 2023, die Spitze der Charts zu erreichen und im Februar 2025 den Grammy für die beste Rock-Performance zu gewinnen. Nicht zuletzt unter kommerziellen Gesichtspunkten wächst die Bedeutung, wie weit eine KI ihr Ausgangsmaterial für Simulationen nutzen kann, also etwa die Stimme eines toten Stars wie Elvis Presley sogar Lieder singen lässt, die er zu Lebzeiten nie in seinem Repertoire hatte. Bei dem Material, mit dem diese KIs gefüttert werden, entsteht eine besondere verwertungsrechtliche Komplexität – sowohl hinsichtlich der Komponisten, Textdichter oder Verlage als auch bezüglich der aufführenden Musiker, die im Pop-Bereich etwa bei einer Band wie den Beatles oftmals in beiden Rollen sind.

Im Zuge solcher KI-Weiterentwicklungen brachte der dänische Fachanwalt Peter Schonning während der 11. Internationalen Urheberrechtskonferenz im November 2023 in Berlin eine Anpassung nicht nur des Urheberrechts, sondern auch der Definition eines künstlerischen Produkts ins Gespräch. Ob man nicht zum Beispiel ein durch KI generiertes Bild dann als Reproduktion definieren sollte, wenn es überwiegend den Vorbildern ähnlich sieht, mit denen die KI geschult wurde. Ein solches Bild wäre dann rechtlich wie eine mediale Vervielfältigung zu behandeln. Analoges könnte auch für ein klingendes KI-Produkt etwa im Stil eines bestimmten Komponisten oder eines Songs der Beatles gelten, wenn darin die fürs Training der KI genutzten Partituren oder verwerteten Audios noch deutlich und über weite Strecken zu erkennen sind. Wäre dann aber auch der umgekehrte Fall denkbar, dass ein KI-Musikprodukt ähnlich wie eine Collage oder ein Mix dann als eigenständiges Werk angesehen würde, je weniger Trainingsmaterial darin identifizierbar ist und je mehr künstlerische Umwandlung oder Neukontextualisierung es darin gibt?

Ethische Balance

Der Deutsche Musikrat formulierte im Herbst 2023 ein Thesenpapier Künstliche Intelligenz und Musik – Hilfe oder Konkurrenz in dem er dazu aufrief, die »ethischen, künstlerischen, sozialen, rechtlichen und innovativen Elemente dieser Entwicklung in eine Balance zu bringen«. In diesem Papier, das als »Living Paper« stets erweitert und aktualisiert wird, wird zudem gefordert, dass der Urheberschutz auch künftig – in Beibehaltung des »Schöpfer:inprinzips« – an den kreativen Menschen gebunden bleibt, auch wenn »das Erzeugnis einer KI als Ausgangspunkt für anschließende kreative Leistung eines Menschen dienen kann«. Nach dem KI-Gesetz der EU können nur persönliche geistige Schöpfungen eines Menschen urheberrechtlichen Schutz genießen, nicht aber rein KI-generierte Inhalte.

Eine Urheberschaft käme allenfalls für den Nutzer der KI in Betracht, wenn dieser das KI-Modell bloß als Werkzeug eingesetzt hätte, als Instrument zur Realisierung eines Werkes, dessen Basis von einem Menschen geschaffen wurde. Im Ende 2023 ausgehandelten, am 21. Mai 2024 von allen 27 EU-Mitgliedstaaten verabschiedeten und ab dem 1. August 2024 in Kraft gesetzten KI-Gesetz der Europäischen Union wird bei KI-generierten Werken grundsätzlich die Einhaltung des EU-Urheberrechts gefordert sowie eine detaillierte Transparenz der Daten, mit denen die KI gefüttert wurde – wobei konkrete Umsetzungen noch der Klärung bedürfen.

Schon seit einiger Zeit nutzen Tech-Unternehmen die Praxis des »data mining«, um das Internet nach Text-, Bild- und Audio-Material zu durchsuchen und ihren KIs damit den nötigen Lernstoff zu liefern. Nach dem KI-Gesetz müssen sie nun darstellen, mit welchen Werken sie ihre KI-Modelle geschult haben.

Ein KI-Büro der EU-Kommission hat die Aufgabe, für die Zusammenfassung solcher Trainingsdaten eine Vorlage zu erstellen. Damit sollen die Kreativen bzw. Rechteinhaber in die Lage versetzt werden, »ihre« Werke im Falle einer Trainings-Verwendung beim entsprechenden KI-Modell zu finden. Außerdem ist für die Rechtsinhaber die Möglichkeit vorgesehen, Werke für das Training von KI zu sperren. Ansonsten wäre es nämlich erst einmal erlaubt, auch geschützte Inhalte für das bloße KI-Training zu nutzen, während bei einer anschließenden Nutzung KI-generierter Ergebnisse die schwierige Aufgabe entstünde, ggf. prüfen zu müssen, inwieweit vorbestehende Werke darin identifiziert werden können.Inzwischen gibt es eine wachsende Zahl generativer KI-Musik-Tools, die das Musikmachen für alle, die Erstellung eigener Songs durch sprachliche Eingabeformen ermöglicht.

Das universelle Instrument

Als Entwicklungsziel solcher Tools sehen etwa die Macher der global erfolgreich verbreiteten Musik-KI Suno AI weniger einen Musikautomaten als vielmehr ein universelles Musikinstrument, das ohne besonderes Können oder Wissen einsetzbar ist. Jeder soll damit in die Lage versetzt werden, Musik nicht bloß zu konsumieren, sondern nach seinen eigenen Vorstellungen und Bedürfnissen auch zu erzeugen.

Bisher wirkt Suno AI zwar noch sehr formatiert und standardisiert bei den klingenden Resultaten. Aber schon jetzt zeigt das Tool einen deutlichen Zuwachs an Gestaltungsmöglichkeiten bei gleichzeitiger Erleichterung der Bedienung.

Mit einfachen Sprachbefehlen, sogenannten Prompts, können die Nutzer:innen auch komplexere musikalische Gebilde und Formen generieren lassen oder ihre gewünschten Musikformen und Veränderungen vorhandener Audios beschreiben, die dann gleich in mehreren Varianten realisiert werden. Offen bleibt, ob sich mit solchen KI-Tools nicht die Bildung musikalischer Bubbles bzw. personalisierter Echokammern – also die Reduktion auf ein »mehr vom Gleichen« wie bei den Streaming-Diensten – noch weiter verstärkt oder ob damit eher neue Möglichkeiten und Formen des musikalischen Ausdrucks unabhängig vom Bildungsstand der Nutzer entstehen. Gegenüber den über die Eingabe von Prompts Musik-Audios generierenden KI-Tools Suno oder Udio liefert das Sprachmodell Google Gemini nach bestimmten Anweisungen sehr detaillierte Beschreibungen, wie ein gewünschter musikalischer Verlauf beschaffen sein könnte, die dann von einem Komponisten in eine musikalische Partitur transformiert werden können.

Sein musikalisches Wissen schöpft Google Gemini aus einer gewaltigen, Epochen und Genres übergreifenden Menge von Texten über Musik. Die nicht immer, aber oft brauchbaren und umsetzbaren Vorschläge dieser KI umfassen den formalen Aufbau einer Komposition, die klangliche Besetzung ihrer Teile, Tempi und Dynamik oder auch tonale oder atonale lineare und vertikale Verläufe bis auf die Ebene von Intervallfortschreitungen. Wegen der musikalisches Wissen und Können voraussetzenden menschlichen Partizipation am klingenden Musikergebnis eröffnet Google Gemini einen höheren Interaktionsgrad und damit auch ästhetischen Horizont zwischen Mensch und Maschine. Insgesamt scheinen KI-Tools als Instrumente der Musikerzeugung die Verschiebung traditioneller Materialästhetik in Richtung einer Gehaltsästhetik zu verstärken – ein künstlerischer Trend, den der Philosoph Harry Lehmann 2023 in seinem Buch Musik und Wirklichkeit für die Digitalkultur diagnostizierte.

Neue Kontexte für bestehende Musik

Schon mit dem digitalen Medium des Samples und der DJ-Art zeichnete sich ab, dass künstlerische Innovationen weniger die Neuheit des klingenden Materials betrafen als gehaltlich motivierte Neukontextualisierungen bereits bestehender Materialien. Die zunehmende Perfektionierung heutiger KI-Musiksysteme könnte vielleicht auch dazu führen, so ein utopischer Gedanke Lehmanns, dass Künstler:innen sich in ihren mithilfe solcher Tools erzeugten Werken stärker mit »gesellschaftlichen, politischen oder philosophischen Themen« beschäftigen.

Inwieweit würden solche Transformationen von Bestehendem jenseits eines bloßen Kopierens oder Plagiierens, also das künstlerische Variieren, Vermischen oder Weiterentwickeln von zuvor Gehörtem, als noch verwertungsrechtlich relevant oder als schon charakteristisch für ein neuartiges Musikmachen bewertet werden? Die Herausforderung scheint groß, hier eine internationale Verteilungsgerechtigkeit zu gewährleisten, ohne die Entfaltung eines neuen musikalischen Formenreichtums zu behindern. Passt die säuberliche Trennung zwischen Werk, Bearbeitung, Interpretation und Aufführung überhaupt noch zu einer digitalen und KI-unterstützen Musikpraxis?

Etwa wenn sich neue Perspektiven in Richtung gemeinsamer künstlerischer Prozesse von Mensch und Maschine eröffnen, wie etwa beim KI-Kooperationsprojekt Spirio derTechnischen Hochschule und der Hochschule für Musik in Nürnberg. In diesem Projekt improvisieren Mensch und Maschine miteinander, beeinflussen sich im Verlauf wechselseitig und lassen dabei überraschend neue Töne entstehen. Die hierfür eingesetzte Künstliche Intelligenz steuert einen selbstspielenden Konzertflügel und erzeugt im Dialog etwa mit einem Jazz-Saxofonisten musikalisch originelle Ergebnisse. Welchen rechtlichen Klärungsbedarf würde es für solche neuartigen ästhetischen Resonanzen geben – beispielsweise was das Lernmaterial der KI sowie die mit ihr inter-agierenden Musiker betrifft?

Gilt Kunstfreiheit für Maschinen?

In seinem Beitrag Können sich Maschinen auf Kunstfreiheit berufen? für die Süddeutsche Zeitung vom 23. Juli 2024 widmete sich der Jurist und ehemalige Richter am Bundesverfassungsgericht Udo Di Fabio den widerstreitenden Grundrechtspositionen zwischen der Kunstfreiheit und dem Eigentumsrecht von Urhebern im Horizont solcher KI-Entwicklungen. Seiner Ansicht nach wird die »Veränderung von Programmierung zum automatisierten Data-Mining und zum selbstbezüglichen Training« sehr bald auch »bislang Ungedachtes hervorbringen, womöglich sogar ›Ungefühltes‹ und ›Ungeahntes‹«. In diesem Zusammenhang stellt sich für Di Fabio die Frage, »ob und wenn ja wann ein maschinell generiertes Musikstück« urheberrechtlich geschützt sein kann. Da Maschinen keine »Rechtspersönlichkeit« sein können, lägen die Rechte dann bei den Entwicklern und Betreibern der KI? Und sollte für die künstlerische Qualität eines auf diese Weise entstehenden Musikstücks die rechtlich erforderliche »Schöpfungshöhe« festgestellt werden, fragt Di Fabio weiter: »Wenn etwa jemand die Anwendungsbefehle kunstvoll formuliert, die Auswahl steuert und kuratiert, die KI somit seinen Prompts raffiniert lenkt … was wird dann geschützt, ein komplexer Anwendungsbefehl oder das daraus entstehende Werk?«

Er kommt zu dem Schluss, dass es für eine faire Nutzungsregelung keine Blockade technischer und künstlerischer Entwicklungen braucht, sondern einen neuen »Werk- und Schöpfungsbegriff für die sich gerade neu formierende Wirklichkeit KI-generierter musikalischer oder anderer künstlerischer Werke«.

Wer spielt die Töne?

In seinem Anfang 2024 erschienenen Buch Literary Theory for Robots sieht Dennis Yi Tenen, Software-Entwickler und Literaturwissenschaftler an der New Yorker Columbia University, die Künstliche Intelligenz vor allem als soziales, kollektives und kulturelles Phänomen. Man sollte diese Technologie nicht mit einem magischen Geist verwechseln, der zu selbstgesteuertem Handeln fähig sei. Vielmehr verortet Tenen KI unter Werkzeugen wie Wörterbüchern oder Text verarbeitungsprogrammen, die den Akt des Schreibens, Denkens und Kommunizierens immer schon begleitet haben und die das Resultat jahrhundertelanger gemeinsamer menschlicher Anstrengungen und Kenntnisse sind. Dass solche Werkzeuge oder Instrumente nun auf einem neuen Level automatisiert werden, erweckt sie für ihn nicht zum Leben. Während Maschinen seit dem Ende des 18. Jahrhunderts zunehmend körperliche Arbeiten des Menschen übernahmen, gilt Ähnliches nun für geistige Arbeiten.

So nachvollziehbar mit solchen Veränderungen einhergehende Ängste damals wie heute auch waren und sind, geht es Dennis Yi Tenen letztlich darum, diese Werkzeuge als Erweiterungen menschlicher Handlungsmöglichkeiten zu verstehen und sie verantwortungsvoll einzusetzen. KI kann in künstlerischen Bereichen wie der Musik nicht nur dadurch behilflich sein, Prozesse wie das Recherchieren und Organisieren von Inhalten oder sich wiederholende Aufgaben mittels Automatisierung effizienter zu gestalten und somit mehr Raum für die kreative Arbeit zu gewinnen. Die Technologie hat zudem das Potenzial, die Kreativen bei der Generierung von Ideen oder der Kollaboration mit anderen Akteur:innen zu unterstützen oder, wie im Spirio-Projekt, selbst zum kollaborativen Partner zu werden.

Ein tieferes Verständnis für die Zukunft und die Möglichkeiten unserer digital erweiterten Werkzeuge ist daher für Dennis Yi Tenen im Kulturbereich weniger von den MINT-Fächern abhängig als vielmehr von den Geisteswissenschaften – etwa damit reflektierende Menschen bessere KIs und Roboter erziehen, indem sie ihnen gute Geschichten erzählen.

Wird Herr Müller ersetzt?

In seinen Schriften zur Musik und Politik prognostizierte der Komponist Hanns Eisler bereits 1962, dass es nicht nur Maschinen geben wird, »die Symphonien komponieren können«, sondern dass auch »der schwitzende Posaunist Müller durch eine Maschine ersetzt werden wird – und auch vor allem der Dirigent«. Hintergrund dieser Utopie war weniger ein technisch-ästhetischer als vielmehr ein klassenkämpferisch-politischer, insofern es dabei um eine Befreiung des Musikbetriebs von Ausbeutung und Hierarchien ging.

Etwas mehr als 60 Jahre danach, im Oktober 2024 wurde die Vision Eislers tatsächlich realisiert: In ihrem Konzertprojekt »Roboter. Sinfonie« ließen sich die Dresdner Sinfoniker erstmals von einem Roboter dirigieren. Für das Projekt konnten Spezialisten aus dem Exzellenzcluster CeTI (Centre for Tactile Internet with Human-in-the-Loop) der Technischen Universität Dresden gewonnen werden. Die Dirigierbewegungen wie das Taktschlagen oder das Anzeigen von Dynamiken für ein bestimmtes Werk »lernte« der Roboter etwa per Datenhandschuh. Der mit drei Armen agierende Roboter MaiRA Pro S trainierte vor seinem Konzerteinsatz zwar mit einem »richtigen« Dirigenten das aufzuführende Repertoire, konnte danach aber etwas, das kein menschlicher Maestro allein vermag: ein in drei Gruppen aufgeteiltes Ensemble gleichzeitig in drei verschiedenen Tempi dirigieren.

In der Aufführungssituation setzte der Roboter das Antrainierte mit seinen über sieben Gelenke verfügenden Maschinen armen präzise um, entfaltete dabei allerdings keine »eigene«, KI-generierte künstlerische Intelligenz. Auch wenn dieses neue »Instrument« Horizonte öffnet für die Aufführung neuartig komplexer Musikwerke in technischer Perfektion, stellt sich die Frage, wie weit und wie nachhaltig der ästhetische Horizont solcher Musikereignisse über eine erste artistische Faszination hinaus sein kann.

Der Dirigent als Automat?

Ähnelt der Roboter-Maestro, auch wenn er ein aus Menschen bestehendes Ensemble live dirigiert, mit seinen eingespeicherten Bewegungen nicht eher einem selbstspielenden Klavier, einem Musik automaten? Erschöpfen sich der Ereignischarakter und die Aura solcher Aufführungen mit ihren vorprogrammierten, immer gleichen Abläufen nicht sehr schnell im Vergleich zu von Menschen dirigierten Live-Konzerten mit ihren vielen spontanen und unvorhersehbaren, künstlerisch oder emotional motivierten Variablen?

Vielleicht wären als weitere Stufe der musikalisch-technischen Evolution einmal anthropomorph gestaltete und mithilfe einer KI lernende Musik-Roboter vorstellbar. Als Lernmaterial käme für die KI solcher zum Beispiel ein Musikinstrument wie die Geige spielenden Roboter nicht nur die gesamte Violinliteratur inklusive ihrer medial zugänglichen Interpretationen infrage, sondern das spielerische Können würde ihnen auch körperlich von konkreten Personen auf realen Instrumenten beigebracht. Auf der Basis des so Erlernten könnten die Roboter-Virtuosen selbstständig und im besten Fall noch untereinander vernetzt ihre musikalische und spieltechnische Kompetenz weiter ausbauen. Das mithilfe ihrer Roboter-KI erworbene Wissen und Können würde nicht nur in die Fähigkeit münden, Geigenliteratur im Stil bestimmter Violinvirtuosen zu interpretieren, die diese vielleicht nie zuvor gespielt haben, sondern auch in die Erzeugung neuartiger Interpretationsversionen etwa der Solo-Partiten von Johann Sebastian Bach aus der Vermischung verschiedener Stile.

Außerdem könnten die Geige spielenden Roboter von pädagogisch erfolgreichen Stargeiger:innen für den Einsatz als Geigenlehrer geschult werden und deren Interpretationskunst über ihren Tod hinaus einer unbegrenzten Zahl von Studierenden vermitteln. Was die urheberrechtliche Seite einer solchen Vision betrifft, gäbe es möglicherweise relevante Anteile nicht nur bei den Kompositionen und ihren medial oder physisch vermittelten Interpretationen, mit denen die Roboter-KI gelernt hat.

Tote Stimmen werden leben

Da Computerprogramme in der EU ebenfalls unter das Urheberrecht fallen, kämen wohl auch diejenigen verstärkt in den Blick, die den Roboter programmierten, die Algorithmen entwickelten und seine kreativen Parameter festlegten. Jenseits des KI-Bereichs wären noch Patente bei den technischen Erfindungen denkbar wie den beim Roboterbau zum Einsatz kommenden Materialien oder der Konstruktion seiner Motorik – etwa für die beim Geigenspiel so wichtige Beweglichkeit und Sensitivität der Finger.

Derzeit dient generative KI beim Machen von Musik oftmals als Zeiteinsparer, mit dem sich bestimmte Studio-Routinen wie der Audio-Schnitt automatisieren lässt. Zudem kann sie Songs im Stil und mit den Stimmen von Sängern erstellen, die noch leben oder bereits tot sind. Und sie lässt sich für die individuelle Erzeugung neuer Arten von synthetisierter, funktionaler und personalisierter Musik nutzen. Bei einer zunehmenden Individualisierung von Musik stellt sich allerdings die Frage, ob es dann künftig noch Musiken geben wird, die zum Bestand eines kollektiven Musikbewusstseins beitragen.

Und wenn es einmal »physische« KI-Musikroboter geben sollte, die schneller als jeder Mensch Musik in den unterschiedlichsten Stilen performen, drängt sich die weitere Frage auf, wie weit der Mensch für die Produktion von Musik überhaupt noch benötigt wird. Welchen Wert werden Schöpfertum und Interpretationskunst des Menschen haben, angesichts immer mächtiger werdender Musik-KI und ihrer Erzeugnisse? Mit einer solchen Musik des Instruments als Mensch konkurrieren zu wollen, scheint wenig Sinn zu machen.

Der Rahmen der Trainingsdaten

Doch auch wenn die KI-Musikinstrumente immer leistungsfähiger werden, wenn sie statt bloß zu standardisieren oder zu reproduzieren, zunehmend künstliche und künstlerische Intelligenz miteinander verbinden und musikalisch originelle sowie schlüssige Ergebnisse liefern, bleiben diese meistens noch im Rahmen des Vorhandenen, das heißt der zugrunde liegenden Trainingsdaten. Zudem zeichnet sich wegen der wachsenden Verarbeitungsgeschwindigkeit von KI-Modellen schon jetzt ein Problem des Schwunds beim noch nicht verarbeiteten Trainingsmaterial ab. Die Verarbeitung vollzieht sich nämlich schneller als die Erzeugung neuer menschlicher Inhalte. Die Hoffnung, das Training dann mit von speziellen KIs generierten Inhalten fortzusetzen, erweist sich nach bisherigen Studien als wenig aussichtsreich, da sich die Qualität der Ergebnisse schnell verschlechtern. Ein Phänomen, das schon mit dem Bild des Ouroboros verglichen wurde, also mit einer Schlange, die sich zu einem Kreis formt und selbst in den Schwanz beißt.

Zwar lässt sich vermuten, dass zum Beispiel Hintergrundmusiken in bestimmten Stilen verstärkt von KI-Modellen erzeugt werden. Auf der anderen Seite aber könnte das Bedürfnis nach einer menschengemachten Musik wachsen, die nicht ausschließlich auf einem zuvor Gelernten und auf simulierten Gefühlen basiert. Eine Musik, die sich aus authentischem menschlichem Erleben und Erfinden speist und so intensiver zu berühren vermag.

Michael Schmidt (Hg.)

Künstliche Intelligenz der Töne

Ethik und Ästhetik digitaler Musikkultur

2025, 124 S.

ISBN 978-3-689-30030-2

€ 22,00